— Вы исследователь дата-этики — можете дать простое определение этому понятию?

— Вообще, обычно я говорю шире, даже курс, который я сделал и веду в «Вышке», называется шире: «Этика применения данных и цифровых технологий». Это первый курс в России о том, как использовать все цифровые технологии с уважением к предназначению и ценностям человека.

— А расскажите о стартапе Segmento, которым вы занимались.

— Мы с партнерами запустили этот стартап в 2012 году, привлекли несколько раундов инвестиций и создали систему, которая собирает с более чем полутора миллионов сайтов данные о том, что люди читают, с какой частотой, как они между сайтами перемещаются, и использовали это для рекламы. Компания дошла до выручки почти в миллиард рублей, мы выиграли вместе со «Сбером» «Каннских львов» за применение данных в рекламе, и в 2019 году мы продали эту компанию «Сберу» окончательно. Это компания, которой я отдал восемь лет своей жизни: я создавал систему, которая собирает поведение людей и на них таргетирует рекламу.

— Я заметил, что это в принципе довольно общее место: об этических рисках, которые приносят технологии, громче и убедительнее всего говорят люди, которые занимались созданием этих технологий. Условно говоря, человек, который создал кнопку лайка, рассказывает, что плохого в этой кнопке.

— ОгилвиДэвид ОгилвиОснователь рекламного агентства Ogilvy. писал в семидесятые годы, что когда он закончит с рекламной карьерой, то под покровом ночи будет в маске ездить и везде уничтожать рекламу, и ни один человек на свете его не осудит. Можно сказать, что любой специалист, работающий в индустриях, эксплуатирующих человека, в какой‑то момент задумывается, насколько это правильно, и в целом видит эту проблему капиталистического мира.

Еще, наверное, многое зависит и от того, что ты в этом рынке делаешь. Я компанию продал и теперь могу называть вещи своими именами — эта та роскошь, которую я очень ценю в своей жизни, возможность не зависеть от мнения клиентов, крупных компаний, акционеров.

— А есть ли среди множества разных этических проблем, о которых вы рассказываете на своих курсах и в подкасте, какая‑то одна, которая вам кажется наиболее важной?

— Я бы так сказал, главная проблема в том, что большинство людей считает, будто есть какая‑то одна ключевая вещь, которую можно исправить. Это видно по тому, как бедного Цукерберга мучают в сенате. Приходит создатель системы, которая соединила всех людей на земле, и дальше все пороки людей реализуются в новой форме. Это не проблема технологий, это проблема общества, но когда Цукерберга вызывают в сенат, его воспринимают как злого волшебника, от которого ждут, что он по волшебству уберет все плохое и оставит все хорошее.

Здесь важно понимать, что технологии, которые сейчас эксплуатируют человеческое внимание, включены в сложную систему общества и нет там мест, которые можно одним поворотом ключика исправить. В частности, именно поэтому я вижу гигантскую проблему с госрегулированием, которое пытается что‑то исправить, не вникая в суть и попутно уничтожая сами системы. Если вы пытаетесь что‑то решить каким‑то законом, то вы, возможно, уничтожите огромную долю пользы сервисов. В этой ситуации требуется разбираться в технологиях, понимать их, все общество должно в этом участвовать. Поэтому я, наверное, вижу проблему в том, что все пытаются найти какую‑то одну отдельную проблему.

Но на самом деле есть точка, на которую можно повлиять, — просто она находится в головах людей. Я смотрел недавно интервью с Гельфандом, это такой популяризатор науки. Он занимается биологией, безумно интересно рассказывает, и вот, говоря про лаборатории, где разрабатывается биологическое оружие, он меняется в лице и говорит: «Я просто не понимаю, что это за люди, как они могут этим заниматься, они персоны нон грата в любом научном сообществе». Это он говорит про таких же биологов, как он, знающих и умеющих то же самое, просто идущих на компромисс со своей совестью, работая там, где они создают вещи, которые вредят людям. Что‑то подобное — внутренний кодекс чести, этики должен появиться внутри IT-индустрии. И все аналитики, проджекты, дата-сайентитисты должны задумываться: «Когда я улучшаю алгоритм, к чему это приводит? Вот я увеличил время, которое пользователь проводит в приложении, в пять раз — а откуда это время забралось-то вообще?» Это приведет к тому, что компании будут вынуждены оглядываться на сотрудников, потому что никто не хочет работать на монстров, производящих оружие. Вот этот сдвиг должен произойти.

Я очень люблю пример с компанией [NtechLab], которая сделала FindFace и обеспечила государство инструментом слежки. Когда профили разработчиков выложили в паблик — не украденные данные, просто профили на LinkedIn, — они все стали резко эти профили закрывать. А я думаю, что кто‑то из них в результате уволится или задаст какие‑то вопросы руководству. Должно быть западло работать на сервисы, которые бесконтрольно и отчаянно взламывают и эксплуатируют человеческое внимание и несут человеку зло.

— Вообще, если смотреть на историю человеческого прогресса, видно, что эта история повторяется: появляется технология, которая решает какую‑то проблему, а потом оказывается, что она приносит свою цепочку проблем, для решения которых появляются новые технологии. Можно ли подумать о технологии, которая сделала жизнь людей лучше и при этом не сделала ее одновременно немного хуже?

— Развитие технологий похоже на маятник. Технологии появляются, маятник набирает ход, у всех паника, когда «технология уничтожает наши жизни, искусственный интеллект отберет рабочие места, мы всю жизнь будем проводить в фейсбуке*». Мы сейчас в фазе этой технопаники и под давлением общества толкаем этот маятник обратно. Мы сейчас используем огромное количество технологий, которые изначально воспринимались как угроза, но ею не были. В Великобритании конца XIX века считалось, что женщины беременеют от того, что ездят на велосипеде, и им законодательно запрещено было это делать. Вот пример того, когда в технологии разглядели угрозу, которой в ней никогда не было. То же самое было с промышленным производством питания: эту отрасль точно так же демонизировали, но в итоге все получили дешевое, быстрое, надежное питание, решив проблему голода.

При этом, естественно, важно видеть и ту угрозу, которую они нам несут. Но, понимаете, я вижу проблему самих технологий в бесконтрольном развитии, в плохом контроле общества и, самое главное, в неправильной системе стимулов. Капитализм построен на ожидании бесконечного роста. Не бывает продукта, который может остановиться, он всегда должен что‑то еще делать, расти. Именно поэтому Apple, который клялся, что у него никогда не будет рекламы, сейчас запустил рекламный бизнес и активно его развивает, идя против своей философии. Все инженеры, которые находятся внутри, возмущены, но Apple не может иначе, потому что нужно всегда расти.

[Сергей] Брин и [Ларри] Пейдж, когда создавали Google, тоже до последнего не хотели идти в рекламный бизнес, который в результате сделал их компанией, которая за всеми следит. Изначально они говорили так: «Появление рекламы сделает нас зависимыми от коммерции, бизнеса и крупных рекламодателей и направит наш продукт туда, куда мы, инженеры, не хотим». Они долго искали баланс, но в результате этот водоворот их затянул. Это и есть то, что нам надо исправлять, менять в целом парадигму. Сейчас парадигма такова, что цифровая компания должна бесконечно расти. Большинство цифровых сервисов выкачивают из нас внимание, и чем больше они выкачивают, тем больше они зарабатывают — замкнутый круг.

Знаете, говорят, что данные — новая нефть. Сравнение заключается в том, что если люди начнут бесконтрольно, не оглядываясь ни на что, добывать неимоверное количество нефти, то они навредят планете. Мы примерно в этой фазе сейчас с человеческим вниманием, когда устройство, которое позволяет большим компаниям зарабатывать на нашем внимании, всегда с нами, и практически нет больше грани между нашей приватной жизнью и жизнью, где мы сталкивались с рекламой. Раньше мы включали телевизор, нажав кнопку, обменивали внимание на информацию, нашим вниманием пользовались и показывали рекламу. А теперь, когда мы все коннектед, мы уже как киборги, у которых есть непрерывная трансляция рекламы в голову.

Мне очень понравилась метафора Тима О’Райли, создателя концепции Web 2.0. Он сравнивает данные не с нефтью, а с песком. Почему песок? Потому что когда кто‑то сказал «новая нефть», то у всех возникло впечатление, что данные очень важны. Это как у себя на заднем дворе найти скважину — у людей и компаний сложилось впечатление, что их данные очень дорого стоят, хотя это вообще не так. А если подумать, какая индустрия сейчас одна из самых растущих, — это микроэлектроника, в которой производятся процессоры. Так вот, в процессорах используется кремний, то есть можно сказать, что процессоры делаются из песка. Значит ли это, что Абхазия, у которой большая песчаная прибрежная линия, — это потенциальный миллиардер? Никто так не скажет. Песок становится ценностью, только когда ты построил невероятно дорогую производственную линейку, потратил кучу денег и получил конечный продукт.

Я считаю гораздо большей проблемой не сбор данных, а эксплуатацию внимания — с использованием в том числе данных, технологий, устройств и способов взлома человеческого внимания.

— Вы упомянули Цукерберга, который связал между собой всех людей, и теперь с него спрашивают за все их пороки. Звучит так, как будто бы вы говорите, что на Цукерберге нет ответственности?

— Я считаю, что Цукерберг взял на себя гигантские бизнес-риски. Он вкладывал миллиарды там, где другие боялись, он пожинает сейчас плоды того, что он вычеркнул годы своей жизни, чтобы построить сильнейшую компанию, которая дает громадную пользу. Все используют его продукт и матерят его. Я вижу огромную проблему в том, что классические медиа, тесно сплетенные с классическими политиками, с большим удовольствием эксплуатируют эту технопанику, перемещая внимание людей на технологии, которые были и раньше.

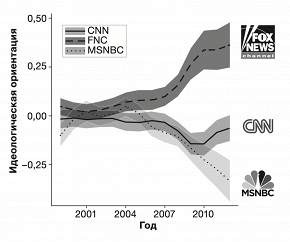

Например, Цукерберга обвиняют в том, что он построил сеть, которая способствует распространению дезинформации, поляризации и прочим порокам общества. Я нашел замечательный график в книге «Полный бред!», в нем показывается, как разделялся прореспубликанский и продемократический контент в США. Это разделение началось благодаря телевидению еще во время, когда фейсбуком пользовалась одна треть населения.

в книге «Полный бред!», в нем показывается, как разделялся прореспубликанский и продемократический контент в США. Это разделение началось благодаря телевидению еще во время, когда фейсбуком пользовалась одна треть населения.

Многие говорят, что фейсбук усиливает проблемы, но и это не так, многие исследования показывают, что степень поляризации через соцсети безумно преувеличена. Тем не менее нарратив в массовом сознании именно такой: «соцсети вас поляризуют». Но вообще-то, когда вы смотрите телевидение, например, в России, вы в еще более крутом пузыре.

Соцсеть — это место, где вы можете в безопасной и комфортной среде столкнуться с другими точками зрения, и это невероятно мощно двигает все наше общество вперед. Кроме того, соцсети устроены так, что они всегда вам дают что‑то новое, чего вы не видели и не смотрели. Если бы алгоритмы все время давали вам контент, который вы и так смотрите, вы бы заскучали — то есть без алгоритма ютьюба или фейсбука вы никогда не найдете людей, мнения, контент, которых вы не искали. Вам не придет в голову смотреть ролик Соловьева, а ютьюб его подкинет: ему важно, чтобы из пяти роликов на главной странице четыре были тем, что вы смотрите обычно, а пятый выводил вас за границы. Поэтому я считаю, что невероятную пользу от алгоритмов мы принимаем как должное, зато полили их ненавистью сверху донизу. И во многом это вина классических, мейнстримных медиа и элит, которых, естественно, возмущает и злит, что появилась штуковина, которую трудно контролировать.

— Очень интересно, что то, о чем вы говорите, — это тот же самый эффект казино: наш мозг так устроен, что мы склонны кликать на кнопочку, если не знаем, чего от этой кнопочки ожидать. Именно благодаря этому эффекту, доведенному до максимума, тикток в какой‑то момент стал самой популярной соцсетью. Выходит, ютьюб, подкидывая вам контент из‑за пределов вашего пузыря, делает это ровно по тем же причинам — чтобы вас удержать и заработать на вас.

— Да, он дает эту непредсказуемость. Хотя должен сказать про эффект казино такую мысль: дело не в том, что создатели соцсетей или цифровых продуктов какие‑то злодеи, которые сидят и думают, как использовать человеческую слабость. Абсолютно одинаковые паттерны поведения крупного бизнеса вы увидите в казино, в трейдинге, в цифровых сервисах и в производстве продуктов питания.

Например, как‑то раз Lay’s решили, что их чипсы плохо продаются, стали изучать рынок и обнаружили, что сегмент 35-летних к ним лоялен, а молодежь не ест. И их цель была в том, чтобы увеличить долю Lay’s в том, что едят люди. Тогда они стали убеждать людей, что есть чипсы — это круто, так же как фейсбук говорит: все твои друзья здесь, заходи. Но они точно так же стали искать казиношные механики — например, того сочетания ингредиентов, при котором человеку максимально вкусно, но не слишком сладко и не слишком жирно, чтобы ввести его в такое же, как в казино, состояние потока, только в поедании. Они тратили на исследования до 30 миллионов долларов в год и даже построили челюсти, которые проверяли хрусткость тысяч разных вариантов чипсов, чтоб найти те, которые будут идеально заставлять человека доесть пачку до конца — хотя ему это не надо, это компании надо. И в тот же самый момент они изобрели Cheetos, которые стали невероятным прорывом, потому что Cheetos обманывают мозг: они создают во рту эффект исчезновения, который обманывает рецепторы, заставляя поверить, что это недостаточно калорийная еда.

Все это произошло, когда Lay’s уперся в потолок.Они просто делали чипсы, просто рекламировали, люди их ели. А акционеры говорят: «Мы в вас вкладываем деньги, чтобы вы росли дальше». Они перебрали ученых и нашли чувака, который научился взламывать ум человека вот таким образом.

При этом никто не говорит, что бизнес Lay’s нужно запретить или сделать с ним что‑то еще. Более того, кстати, давление общества в продуктах питания — очень хороший пример, и я думаю, что он появится в адекватной форме и в цифровых сервисах. Скажем, у Pepsi как раз в результате давления общества появилась десятилетняя стратегия перехода на напитки с минимальным содержанием сахара. То есть они вынуждены придумывать, как бы им меньше вредить потребителям, но при этом сохранять свой бизнес.

— Какие вы видите тонкие места и возможные проблемы, связанные с распространением креативных нейросетей вроде DALL-E или Midjourney?

— Я думаю, что это великолепнейшее поле для рождения кучи новых бизнесов, для избавления людей от занудного monkey-job, от нетворческой работы. Люди, которые занимаются творчеством, создают тексты или графические объекты, — первые кандидаты на то, чтобы стать пилотами этих нейросетей. И я считаю, что на пересечении [человеческого и нейросетевого творчества] родятся невероятно классные шедевры. Кто‑то считает, что роботы нам угрожают, но на самом деле это новые сферы, новые ниши. Все это очень далеко продвинет индустрии, даже культуру, а угроз здесь новых не появляется, остаются только старые.

Этот вопрос находится даже на грани с философией — вот мой партнер по бизнесу Максим занимается философией нейронных сетей. Грубо говоря, появятся другие нейросети, которые будут пытаться интерпретировать и объяснять для человека работу этих нейросетей. Опять же, бизнесу это не нужно, за это никто не платит, но если это будет обязательным, как информация о содержании белков, жиров и углеводов на этикетке, то для этого решение появится. Если коротко, то угроза — это необъяснимость. Когда она будет касаться каких‑то важных решений, это неприемлемо.

Подкаст «Бремя технологий» создан вместе с аудиоплатформой «Толк».

* Facebook принадлежит компании Meta, признанной в России экстремистской организацией, ее деятельность и деятельность ее сервисов в стране запрещена.